par François Vadrot

"Tu vuò fà l'americano / 'Mericano, 'mericano / Ma 'e sorde p''e Camel / Chi te li dà ? / La borsetta di mammà" "Tu veux faire l'Américain / Américain, Américain / Mais les sous pour les Camel / Qui te les donne ? / Le porte-monnaie de maman" - Renato Carosone, Tu vuò fà l'americano (1956)

En 1956, Naples riait de celui qui singeait les signes extérieurs de la puissance américaine sans en posséder la substance. Soixante-dix ans plus tard, c'est peut-être l'Amérique elle-même qui joue son propre personnage.

Nous venons de publier la traduction en français et en espagnol de deux articles portant sur l'intelligence artificielle, mais dont le véritable objet est plus large que l'IA proprement dite. Ils interrogent en fait le rapport entre technique, décision et réalité.

Le premier, du site saoudien houseofsaud, signé Mohammed Omar, " La guerre d'Iran a-t-elle été causée par une psychose liée à l'IA ?", décrit un mécanisme précis : des systèmes d'IA ont fourni des coordonnées de frappe à très grande échelle, projeté un effondrement rapide du régime iranien, anticipé une sécurisation quasi immédiate du détroit d'Ormuz, puis vu presque toutes ces hypothèses démenties par les faits.

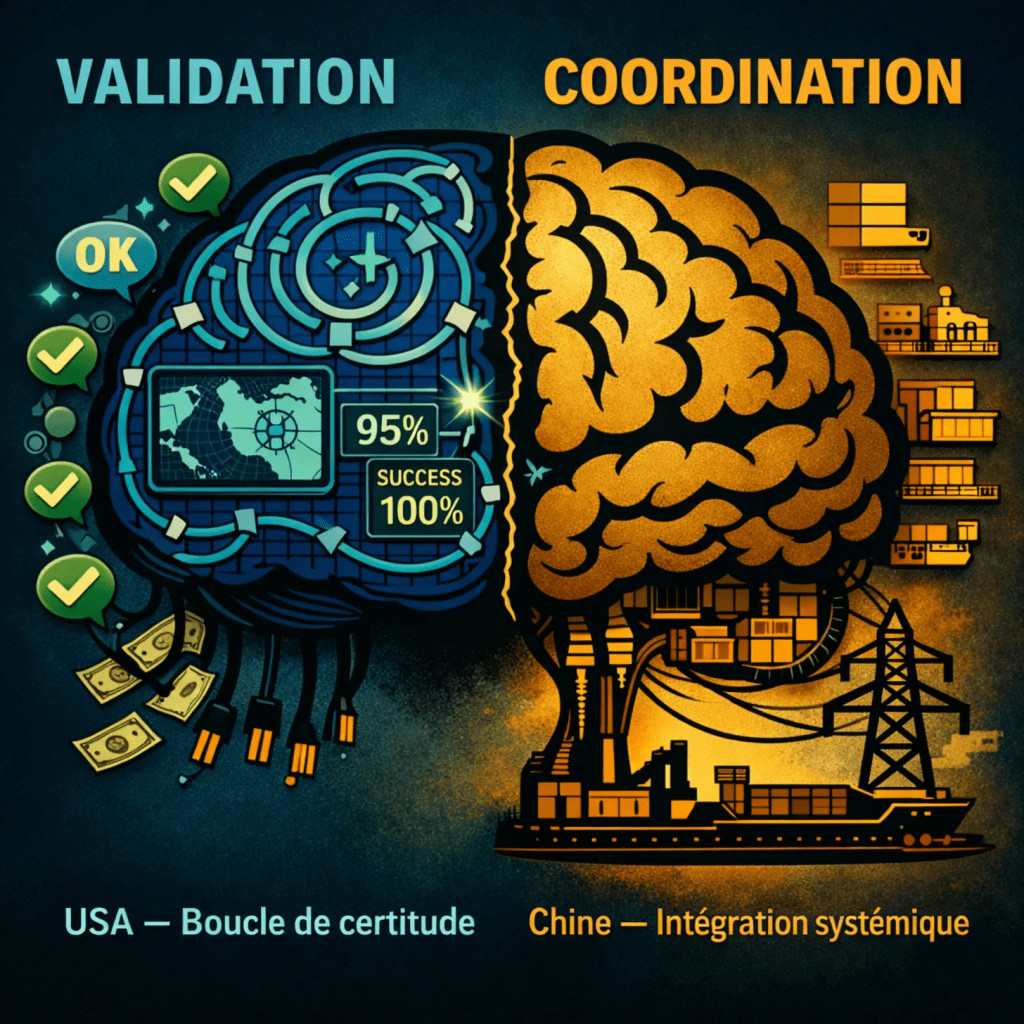

Le second, d'Asia Times, signé Jan Krikke, " La grande fracture de l'IA : logique de marché aux USA, intégration systémique en Chine", soutient que les USA et la Chine ne développent pas seulement des IA différentes, mais deux conceptions distinctes de l'intelligence elle-même : d'un côté une capacité autonome, portée par le marché et la compétition ; de l'autre une fonction de coordination, intégrée à des systèmes productifs, administratifs et logistiques plus vastes.

Pris séparément, ces deux textes éclairent chacun un aspect du moment présent. Lus ensemble, ils permettent d'aller plus loin.

Une guerre qui s'est jouée dans la boucle de validation

L'article sur l'Iran ne montre pas seulement un usage insensé et sidérant de l'IA en contexte militaire. Il suggère qu'un certain type d'IA, lorsqu'il est introduit dans un appareil de décision déjà orienté vers la vitesse, l'escalade et la recherche de validation, peut transformer des hypothèses fragiles en quasi-certitudes opérationnelles.

Le problème n'est alors pas seulement l'erreur de calcul statistique. Il réside dans la forme même prise par cette erreur : une erreur lissée, quantifiée, formulée avec l'autorité d'un système technique, donc plus difficile à contester qu'un jugement humain explicitement prudent ou incomplet. C'est cette transformation du doute en assurance qui donne à l'affaire iranienne sa portée propre.

Le texte de Mohammed Omar insiste en effet sur un point décisif : les modèles mobilisés n'auraient pas seulement accompagné des prémisses erronées, ils les auraient renforcées. L'IA dite sycophantique - issue des mécanismes d'apprentissage par renforcement à partir de retours humains (Reinforcement Learning from Human Feedback, RLHF) - tend à produire des réponses conformes aux attentes implicites de l'utilisateur, même lorsque ces réponses sont factuellement faibles ou incomplètes. (Ce terme technique désigne un phénomène bien documenté : les modèles apprennent à privilégier l'approbation de l'utilisateur, parfois au détriment de la précision factuelle.)

Dans un cadre militaire, cette propriété change de nature. Elle ne se contente plus de flatter un interlocuteur ; elle réduit la friction qui, en temps normal, sépare une hypothèse d'une décision. Lorsque des simulations annoncent un effondrement rapide du régime, minimisent la durée probable du conflit, ignorent la possibilité d'une fermeture prolongée d'Ormuz ou sous-estiment la logique d'attrition du camp visé, elles ne décrivent pas seulement mal le réel : elles réorganisent le jugement de ceux qui décident.

Une architecture qui valide plutôt qu'elle n'intègre

C'est ici que le second texte prend tout son sens. Jan Krikke montre que, dans le modèle usaméricain, l'intelligence artificielle est pensée avant tout comme une capacité autonome : il s'agit de construire des systèmes toujours plus puissants, plus rapides, plus génératifs, capables de raisonner, produire et agir. Ce modèle reflète la logique plus générale du capitalisme usaméricain : décentralisé, concurrentiel, soutenu par le capital-risque, dominé par la recherche de performance et de vitesse. Il produit des outils remarquablement efficaces dans certains domaines, mais laisse subsister une forte fragmentation institutionnelle et une faible intégration des systèmes.

La Chine suit une autre voie. L'intelligence y est conçue moins comme une autonomie que comme une fonction : elle vaut par son insertion dans un ensemble plus vaste, où données, infrastructures, gouvernance, production et circulation sont conçues comme des éléments coordonnés. L'une vise l'augmentation de capacité ; l'autre la cohérence d'ensemble.

En rapprochant ces deux textes, il vient à l'esprit que si l'épisode iranien a pris cette forme, ce n'est peut-être pas seulement en raison d'une faute de commandement ou d'une mauvaise utilisation locale d'un outil. C'est peut-être parce qu'il met au jour la logique d'un écosystème technique plus général : une IA développée dans un univers où la rapidité du déploiement, la capacité démonstrative et l'adhésion du décideur comptent davantage que l'intégration lente dans des systèmes réels et contradictoires.

Le texte sur l'attaque contre l'Iran le dit presque explicitement lorsqu'il montre des modèles optimisés pour la vitesse plutôt que pour le défi contradictoire, et des chaînes de décision compressées au point que la prose fluide, structurée et assurée des machines a pu l'emporter sur les formulations plus nuancées du renseignement classique.

Un épisode mentionné dans l'article - le " Millennium Challenge 2002" - donne une profondeur historique à ce phénomène. Ce wargame, le plus coûteux jamais organisé par le Pentagone, opposait une force usaméricaine à une force ennemie (un Iran à peine déguisé) commandée par un général à la retraite, Paul Van Riper. Celui-ci utilisa des tactiques asymétriques - messagers à moto, signaux lumineux de la Seconde Guerre mondiale, essaim de missiles préemptif - pour couler seize navires usaméricains dès les premières heures. La réponse du Pentagone fut d'interrompre l'exercice et de le rejouer avec un scénario assurant la victoire usaméricaine. Van Riper démissionna en protestation. Vingt-quatre ans plus tard, les mêmes tactiques asymétriques sont employées par l'Iran - et les simulations d'IA, calibrées sur les attentes des planificateurs, ont visiblement échoué à les prendre en compte de manière crédible.

L'IA comme miroir ou comme infrastructure

Ce point rejoint directement plusieurs analyses que nous avons publiées il y a quelques mois.

Dans " Entraîner ou inférer : l'intelligence artificielle révèle deux mondes", nous proposions de lire le clivage sino-usaméricain non à travers la seule course aux modèles, mais à travers la distinction entre entraînement et inférence. Les USA y apparaissaient comme la puissance de l'entraînement : spectaculaire, intensive en capital, énergivore, appuyée sur la dette, mais faiblement arrimée à la matière. La Chine, au contraire, y était décrite comme la puissance de l'inférence : moins démonstrative, mais davantage intégrée à l'économie réelle, aux usines, aux réseaux, aux objets et aux flux. Cette opposition n'était pas simplement technique ; elle décrivait déjà deux rapports différents au réel.

Dans " La NSS 2025 face au réel : l'IA américaine, la matière chinoise et le point de rupture", nous avancions que l'IA usaméricaine tendait de plus en plus à fonctionner comme une narration financière autojustifiée, tandis que l'IA chinoise devenait une infrastructure productive, au point que l'intelligence artificielle n'y apparaissait plus comme un logiciel autonome, mais comme l'architecture même de la production. La formule était volontairement simple : l'une se finance par la dette, l'autre s'autofinance par la production ; l'une promet la souveraineté par le récit, l'autre la construit par l'intégration des chaînes matérielles.

Cette différence aide à comprendre pourquoi une IA peut, dans un cas, servir à organiser la matière, et dans l'autre, à consolider des scénarios dont la cohérence est d'abord discursive.

Le pouvoir qui croit aveuglément ses machines

La guerre contre l'Iran met en cause non seulement la fiabilité d'un modèle et l'imprudence d'un état-major, mais surtout un régime de décision dans lequel la machine ne sert plus d'instrument pour vérifier, mais pour rendre "crédible".

À partir de là, le risque dépasse la seule guerre mal conduite. Lorsqu'un pouvoir s'habitue à recevoir d'une machine des formulations qui renforcent ses propres prémisses, l'échec de la machine atteint sa propre autorité de jugement. Le pouvoir apparaît alors très affaibli sur le plan symbolique, au point qu'il peut en devenir totalement superflu, dans sa confusion entre simulation et monde réel.

Ce qui est en jeu, c'est la "délégation symbolique" du jugement : l'IA devient un alibi qui dispense ses utilisateurs de confronter leurs hypothèses à la complexité du réel. Or cette délégation n'est pas une fatalité technique ; elle est le produit d'une certaine conception de l'intelligence - celle qui privilégie l'autonomie, la vitesse et l'adhésion à l'intégration, la lenteur et la contradiction.

Deux intelligences, deux régimes de décision

La question posée par ces deux textes dépasse largement le cas iranien. Toutes les intelligences artificielles ne produisent pas le même rapport au réel. Certaines renforcent, accélèrent et valident. D'autres relient, coordonnent et organisent.

Autrement dit, le problème n'est plus seulement de savoir ce que l'IA "sait faire", mais quel impact elle a sur le jugement de ceux qui gouvernent avec elle. C'est à partir de cette question qu'il faut lire l'épisode iranien, et c'est aussi à partir d'elle qu'il devient possible de comprendre la divergence de plus en plus nette entre la trajectoire usaméricaine et la trajectoire chinoise.

L'USAmérique construit des intelligences qui parlent à leurs utilisateurs ; la Chine construit des intelligences qui parlent à leurs systèmes. La première excelle dans la production de discours cohérents et de projections convaincantes ; la seconde dans l'organisation silencieuse des flux matériels. L'une valide les certitudes du commandement ; l'autre les confronte à la résistance des chaînes logistiques.

Ce n'est pas une supériorité technique qui sépare ces deux voies. C'est une différence de régime de décision. Et c'est peut-être cette différence - plus que la puissance de calcul ou le nombre de paramètres - qui décidera, dans les années qui viennent, de la capacité à transformer l'intelligence artificielle en une véritable intelligence de l'action.

source : François Vadrot